本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.ldbm.cn/p/343729.html

如若内容造成侵权/违法违规/事实不符,请联系编程新知网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

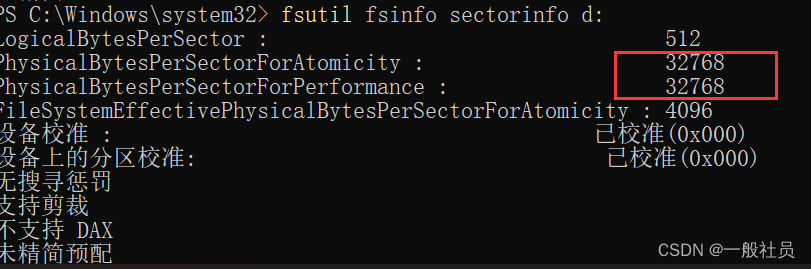

SM2259XT量产工具修复金泰克固态硬盘29F01T2ALCQJ1颗粒开卡

在这里插入代码片前言

网心云用的固态硬盘突然坏了识别不了,磁盘管理、diskGenius、pe系统里均无法识别,查询发现可以用开卡工具修复,遂进行了一番折腾。

拆硬盘

如图硬盘是块金泰克240g容量的,拆开后找到主控芯片型号为SM2259…

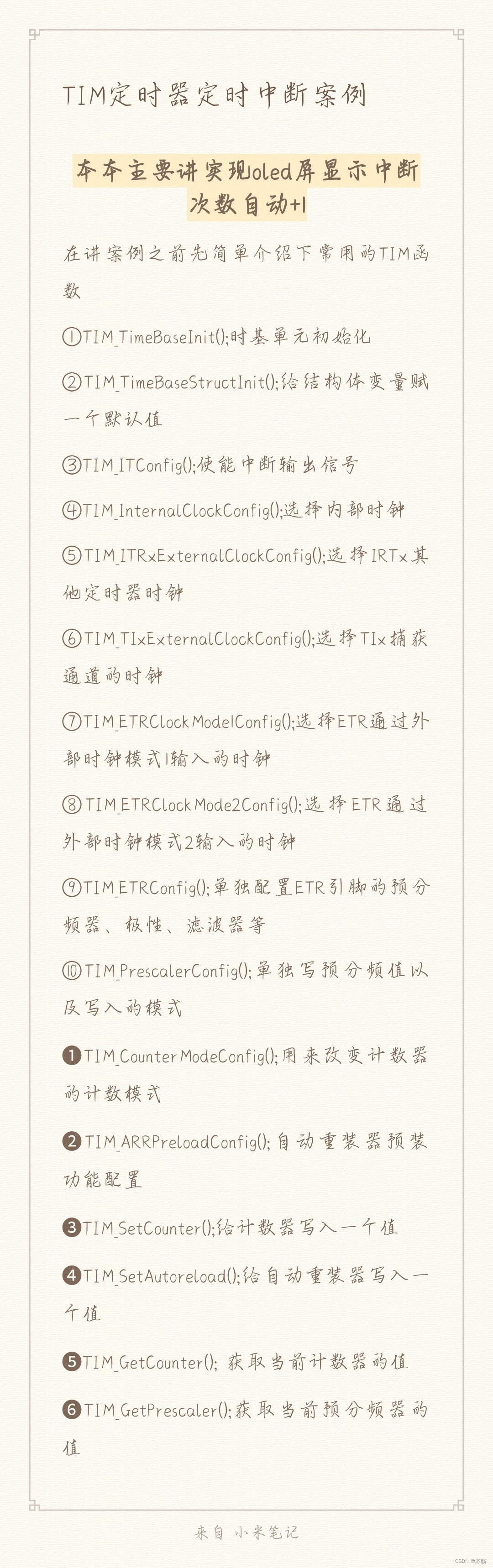

STM32自学☞定时器定时中断案例

timer_interrupt.c文件

/*

初始化函数编写步骤:

1.打开时钟

2.选择时基单元的时钟源(内部时钟源)

3.配置时基单元

4.NVIC配置

5.启动定时器

*/

#include "stm32f10x.h"

#include "stm32f10x_tim.h"

#include …

如何写出别人写不出的内容(译)

(译者序:这篇文章不只是写作,对信息获取、阅读也都有启发。随着社交媒体和 AI 的发展,人们越来越被动的接收海量信息,如何主动查找与整理对自己有用的内容,将是一个不可或缺的能力。)

原文&…

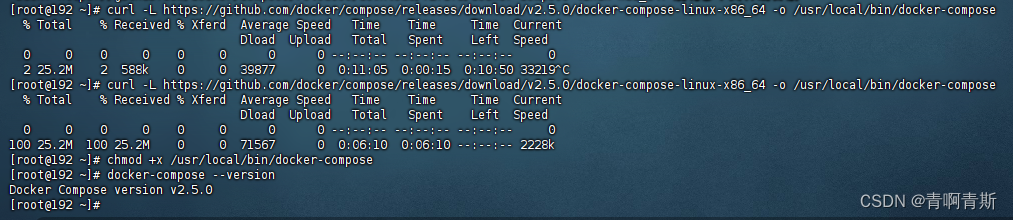

二、docker compose安装

docker compose安装 docker compose的所有版本:https://github.com/docker/compose/releases

# 安装步骤

# 1.下载docker compose:v2.5.0是docker-compose版本

curl -L https://github.com/docker/compose/releases/download/v2.5.0/docker-compose-lin…

windows11安装SQL server数据库报错等待数据库引擎恢复句柄失败

官网:https://www.microsoft.com/zh-cn/sql-server/sql-server-downloads 我的系统是win11的,一开始安装的是2019版本的SQL server安装了好多次,每次都是快结束的时候报错:等待数据库引擎恢复句柄失败。 我以为是2019不兼容win11的…

LLM大模型常见问题解答(3)

简要描述下列概念在大语言模型中的作用

Transformer 架构Attention 机制预训练与微调过拟合和欠拟合

Transformer 架构

Transformer是一种基于自注意力机制的深度学习模型,它在论文“Attention Is All You Need”中首次提出。与此前流行的循环神经网络࿰…

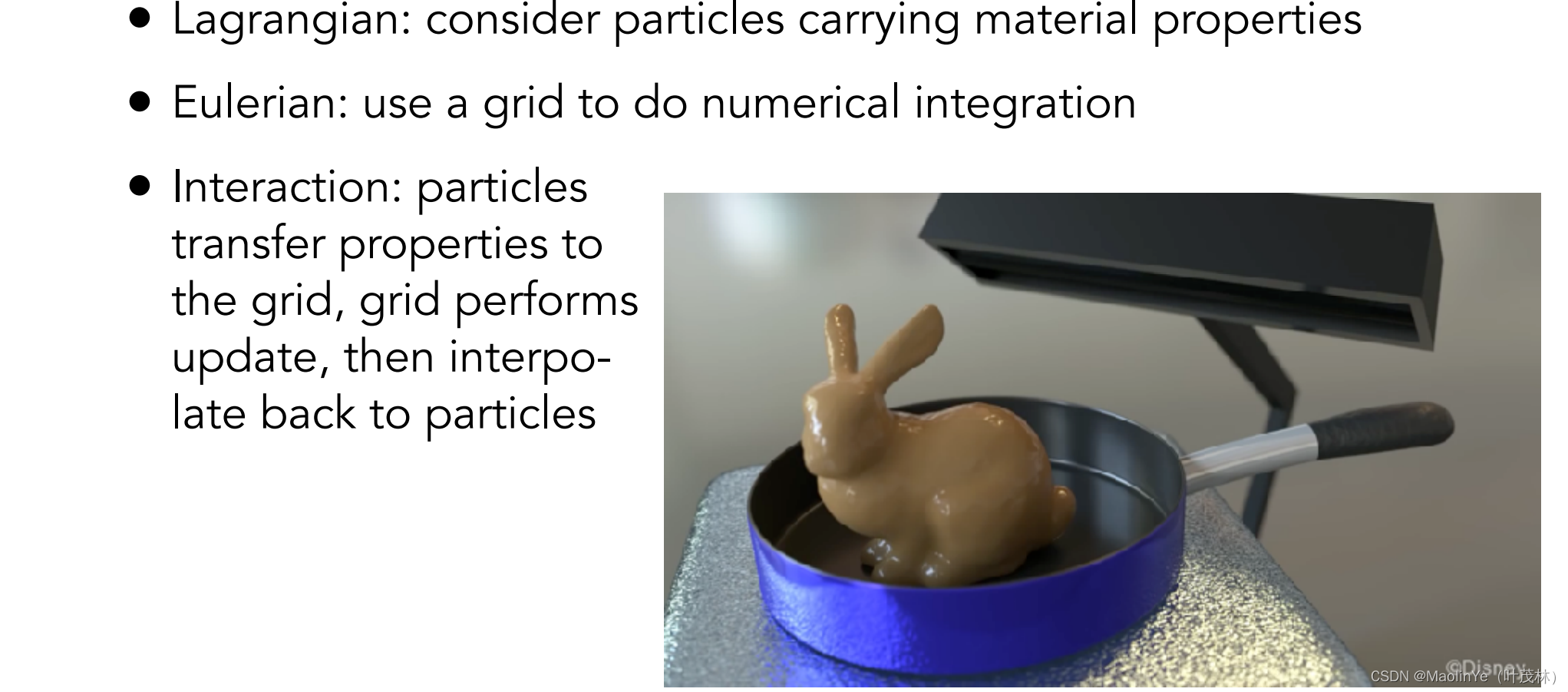

【GAMES101】Lecture 22 物理模拟与仿真

目录

单粒子模拟

显式欧拉方法

改进

中点法/修正的欧拉方法

自适应步长

隐式欧拉方法

非物理改变位置(Position-Based / Verlet Integration)

刚体模拟

流体模拟 单粒子模拟

先来研究粒子的运动,假设有一个速度矢量场,对…

【openwrt】MT7981 5G WiFi MAC地址不生效问题分析及解决方案

问题描述 MT7981 默认sdk 5G MAC地址根据2.4G MAC地址随机生成,我们写到Factory区域的值不生效

问题分析

查看EEPROM MAC位置 查看MTK EEPROM文档MT7981_EEPROM_Content_Introduction_V10_20211207.pdf可以看到EEPROM里面有两个位置可以存放MAC,0x04~0x09 和0x0a~0x0f 查看…

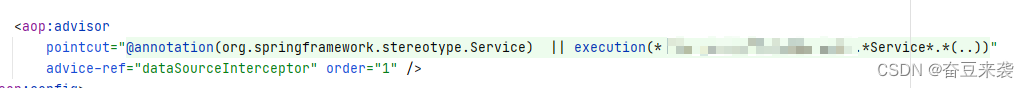

spring aop @annotation的用法

直接看原文:

spring aop annotation的用法-CSDN博客

--------------------------------------------------------------------------------------------------------------------------------

annotation用在定义连接点时,对连接点进行限制。比如我们想对标注了…

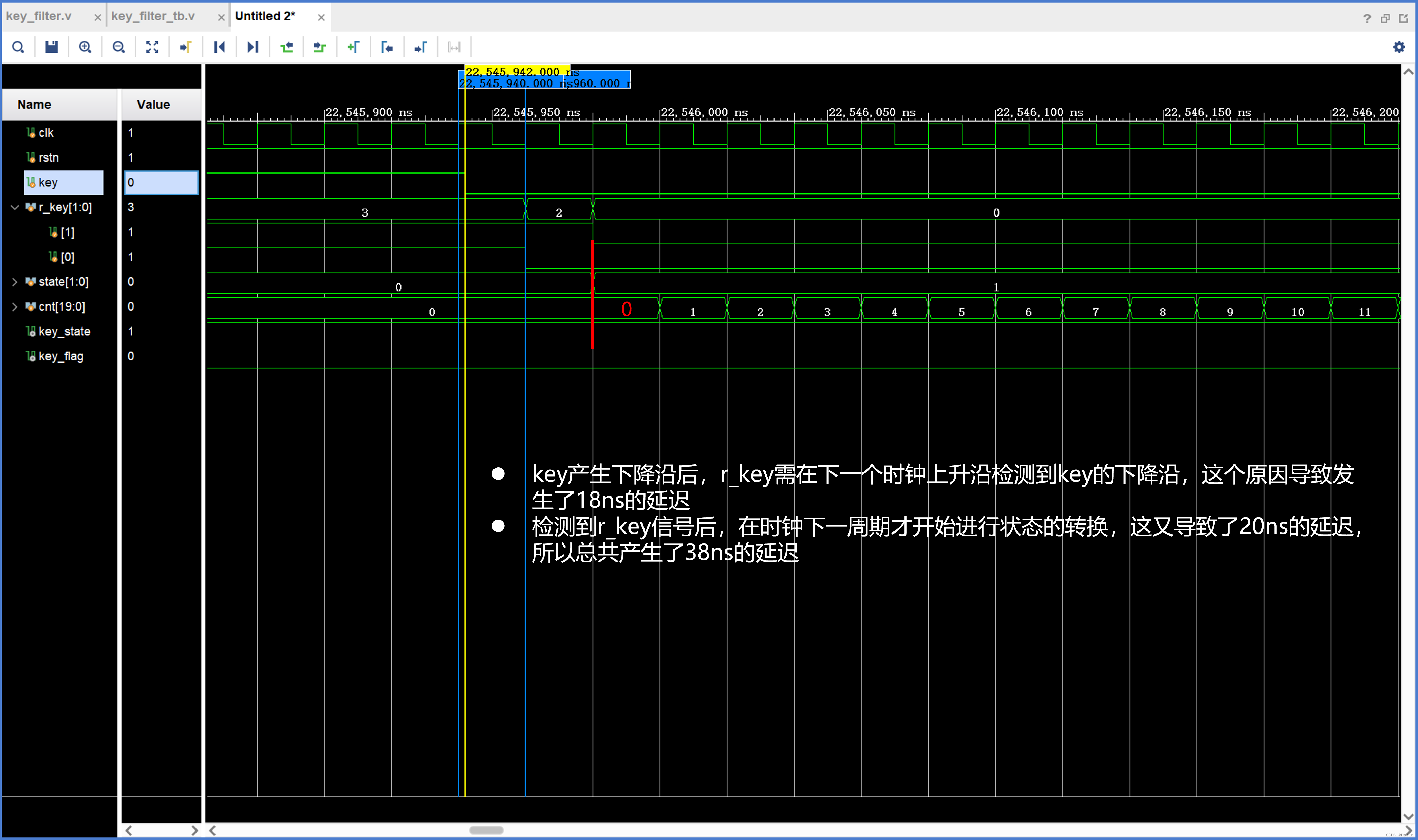

15 ABC基于状态机的按键消抖原理与状态转移图

1. 基于状态机的按键消抖

1.1 什么是按键? 从按键结构图10-1可知,按键按下时,接点(端子)与导线接通,松开时,由于弹簧的反作用力,接点(端子)与导线断开。

从…

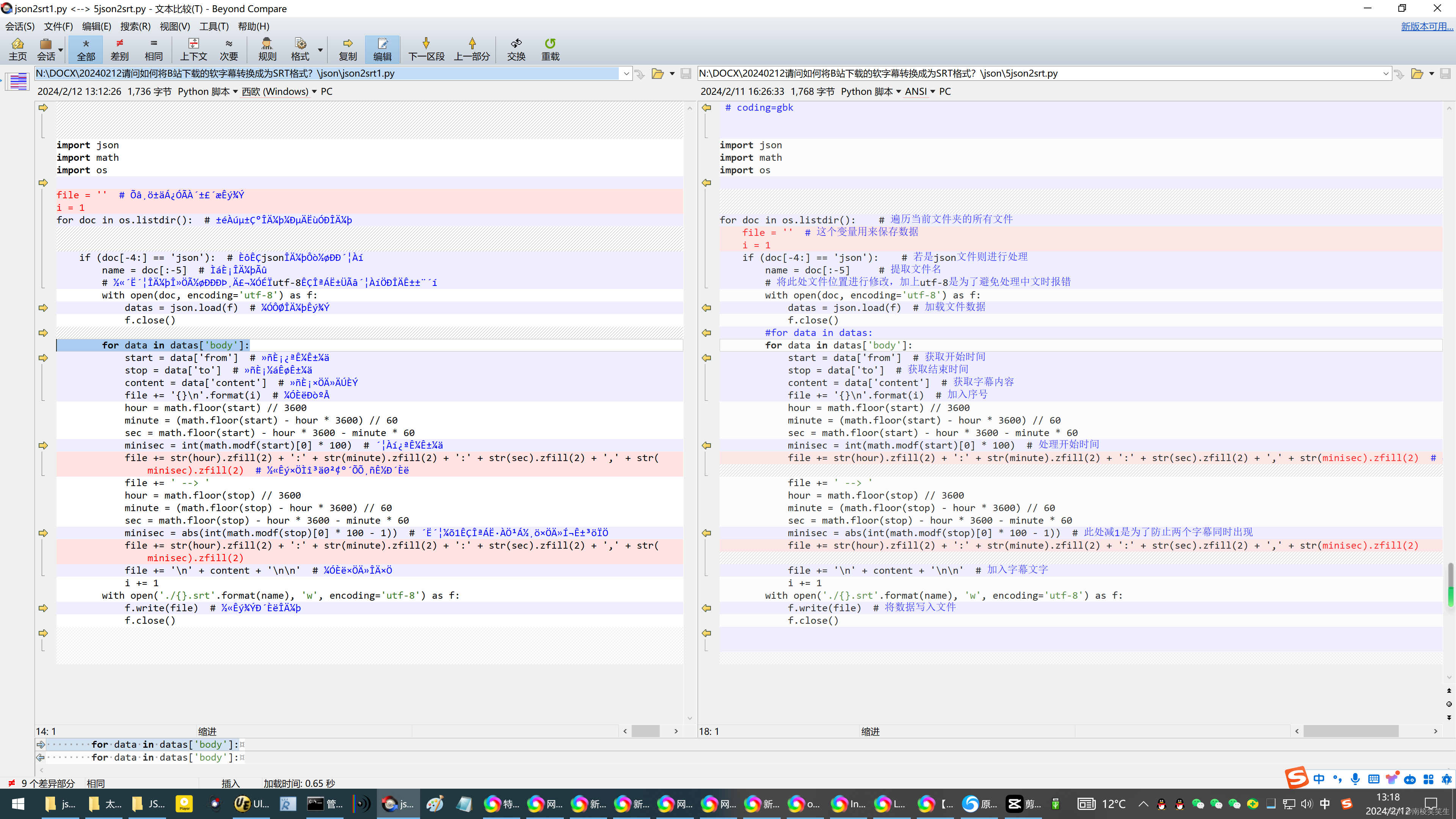

20240212请问如何将B站下载的软字幕转换成为SRT格式?

20240212请问如何将B站下载的软字幕转换成为SRT格式? 2024/2/12 12:47 百度搜索:字幕 json 转 srt json srt https://blog.csdn.net/a_wh_white/article/details/120687363?share_token2640663e-f468-4737-9b55-73c808f5dcf0 https://blog.csdn.net/a_w…

剑指offer——旋转数组的最小数字

目录 1. 题目描述2. 分析思路2.1 示例分析 3. 更完美的做法 1. 题目描述 把一个数组最开始的若干个元素搬到数组的末尾,我们称之为数组的旋转。输入一个递增排序的数组的一个旋转,输出旋转数组的最小元素。例如数组{3.4,5,1.2}为{1.2,3,4,5}的一个旋转&a…

OpenCV-36 多边形逼近与凸包

目录

一、多边形的逼近

二、凸包 一、多边形的逼近

findContours后的轮廓信息countours可能过于复杂不平滑,可以用approxPolyDP函数对该多边形曲线做适当近似,这就是轮廓的多边形逼近。

apporxPolyDP就是以多边形去逼近轮廓,采用的是Doug…

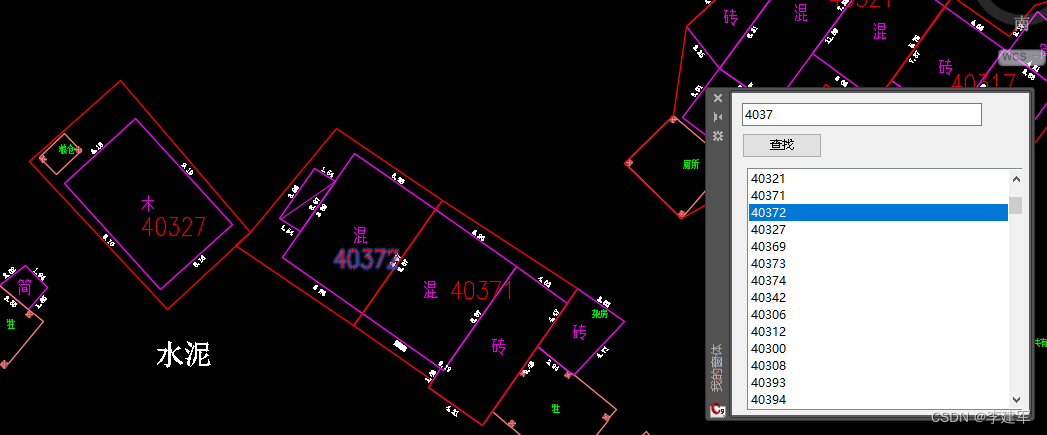

C# CAD交互界面-自定义面板集-查找定位(六)

运行环境 vs2022 c# cad2016 调试成功 一、代码说明

1. 类成员变量声明:

List<ObjectId> objectIds new List<ObjectId>(); // 用于存储AutoCAD实体对象的ObjectId列表

private static Autodesk.AutoCAD.Windows.PaletteSet _ps2; // 自定义浮动面板…

LeetCode:67.二进制求和

67. 二进制求和 - 力扣(LeetCode)

又是一道求和题,% / 在求和的用途了解了些,

目录

题目:

思路分析:

博主代码:

官方代码:

每日表情包: 题目: 思路分析…

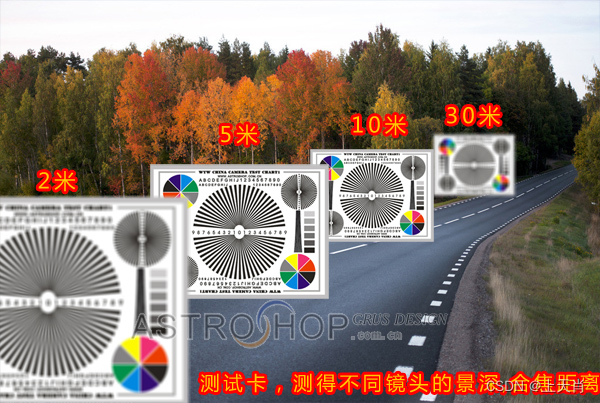

相机图像质量研究(5)常见问题总结:光学结构对成像的影响--景深

系列文章目录

相机图像质量研究(1)Camera成像流程介绍

相机图像质量研究(2)ISP专用平台调优介绍

相机图像质量研究(3)图像质量测试介绍

相机图像质量研究(4)常见问题总结:光学结构对成像的影响--焦距

相机图像质量研究(5)常见问题总结:光学结构对成…

python -m SimpleHTTPServer mac报错

错误内容:

Traceback (most recent call last):File "/System/Library/Frameworks/Python.framework/Versions/2.7/lib/python2.7/runpy.py", line 174, in _run_module_as_main"__main__", fname, loader, pkg_name)File "/System/Libra…

力扣_字符串6—最小覆盖字串

题目

给你一个字符串 s 、一个字符串 t 。返回 s 中涵盖 t 所有字符的最小子串。如果 s 中不存在涵盖 t 所有字符的子串,则返回空字符串 “” 。

示例 : 输入:s “ADOBECODEBANC”, t “ABC” 输出:“BANC” 解释:…

中年中产程序员从西安出发到海南三亚低成本吃喝万里行:西安-南宁-湛江-雷州-徐闻-博鳌-陵水-三亚-重庆-西安(2.游玩过程)

文章大纲 出发时间:Day1-1月25日星期四,西安飞南宁路途中:Day2-1月26日星期五,南宁-湛江-住雷州(曾经支教过的地方)【晚上买徐闻到海安新港】路途中:Day3-1月27日星期六,雷州-徐闻渡…