本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.ldbm.cn/p/364468.html

如若内容造成侵权/违法违规/事实不符,请联系编程新知网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

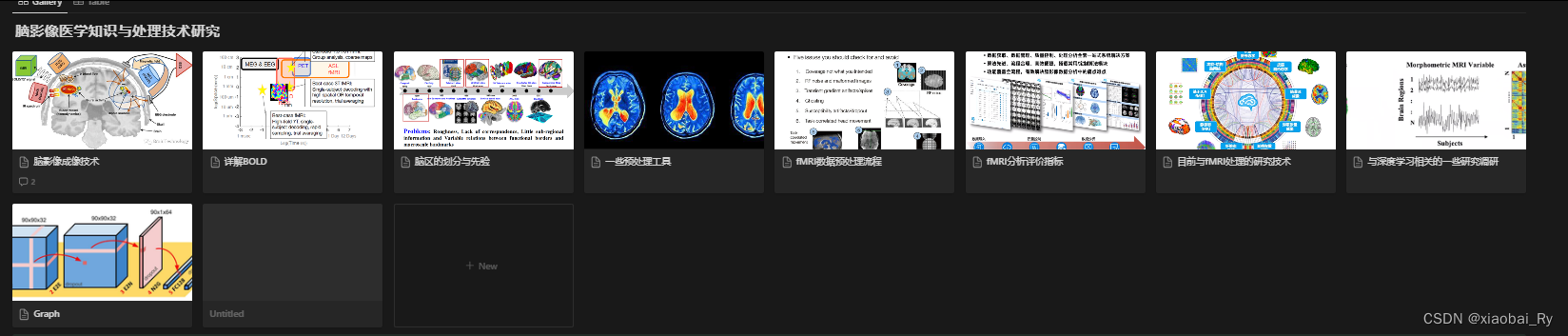

【脑科学相关合集】有关脑影像数据相关介绍的笔记及有关脑网络的笔记合集

【脑科学相关合集】有关脑影像数据相关介绍的笔记及有关脑网络的笔记合集 前言脑模板方面相关笔记清单 基于脑网络的方法方面数据基本方面 前言

这里,我将展开有关我自己关于脑影像数据相关介绍的笔记及有关脑网络的笔记合集。其中,脑网络的相关论文主要…

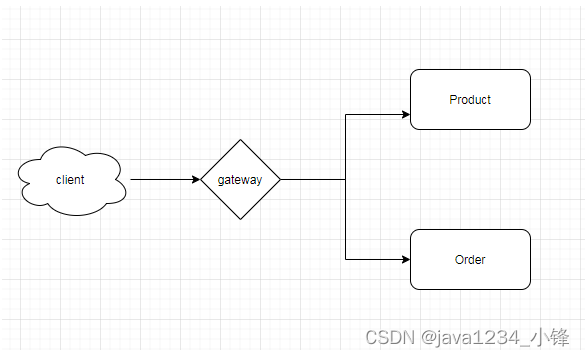

两天学会微服务网关Gateway-Gateway HelloWorld快速入门

锋哥原创的微服务网关Gateway视频教程:

Gateway微服务网关视频教程(无废话版)_哔哩哔哩_bilibiliGateway微服务网关视频教程(无废话版)共计17条视频,包括:1_Gateway简介、2_Gateway工作原理、3…

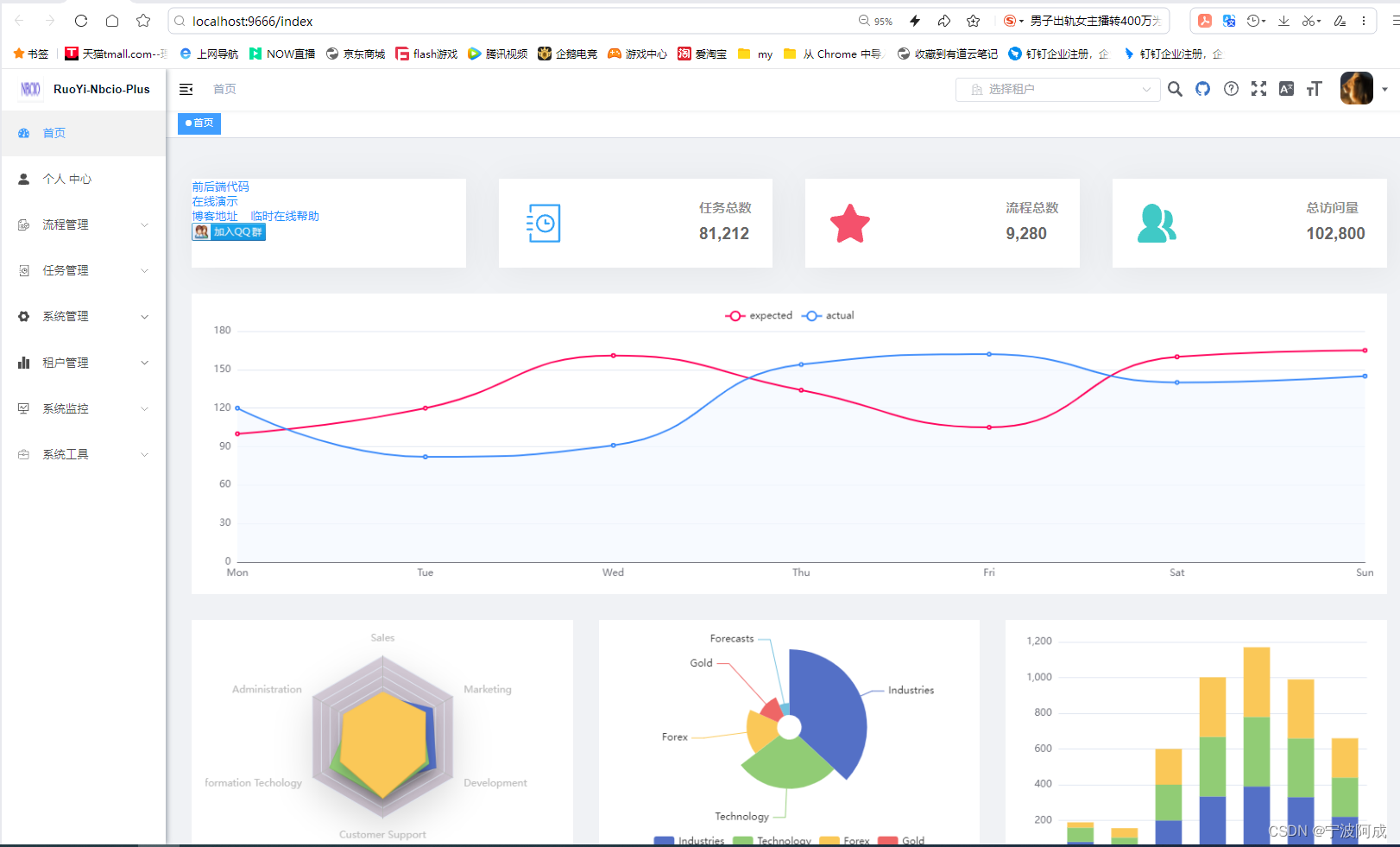

改造ruoyi-nbcio-plus亿事达多租户前端系统的一些记录

更多ruoyi-nbcio功能请看演示系统

gitee源代码地址

前后端代码: https://gitee.com/nbacheng/ruoyi-nbcio

演示地址: http://122.227.135.243:9666

更多nbcio-boot功能请看演示系统

gitee源代码地址

后端代码: https://gitee.com/nbach…

Qt::TabWidget

在Tab的右上角添加控件

QPushButton *add new QPushButton;

add->setText("");

add->resize(30,30);

ui->tabWidget->setCornerWidget(add,Qt::TopRightCorner);

结果:

Tab添加子页

QWidget*newp new QWidget;

ui->tabWidget->add…

如何本地创建websocket服务端并发布到公网实现远程访问

文章目录 1. Java 服务端demo环境2. 在pom文件引入第三包封装的netty框架maven坐标3. 创建服务端,以接口模式调用,方便外部调用4. 启动服务,出现以下信息表示启动成功,暴露端口默认99995. 创建隧道映射内网端口6. 查看状态->在线隧道,复制所创建隧道的公网地址加端口号7. 以…

Java基于SpringBoot的网上租赁系统设计与实现论文

摘 要

本课题是根据用户的需要以及网络的优势建立的一个基于Spring Boot的网上租贸系统,来满足用户网络商品租赁的需求。 本网上租贸系统应用Java技术,MYSQL数据库存储数据,基于Spring Boot框架开发。在网站的整个开发过程中,首先…

进程通信——进程与线程——day15

进程通信分为三类:消息队列、共享内存以及信号灯

今天主要讲一下消息队列以及共享内存

消息队列

1.IPC对象 内存文件ipcs

查看系统重的消息队列、共享内存、信号灯的信息ipcrm 删除消息队列、共享内存、信号灯ipcrm -Q/-M/-S keyipcrm -q/-m/-s 消息队列ID/共享…

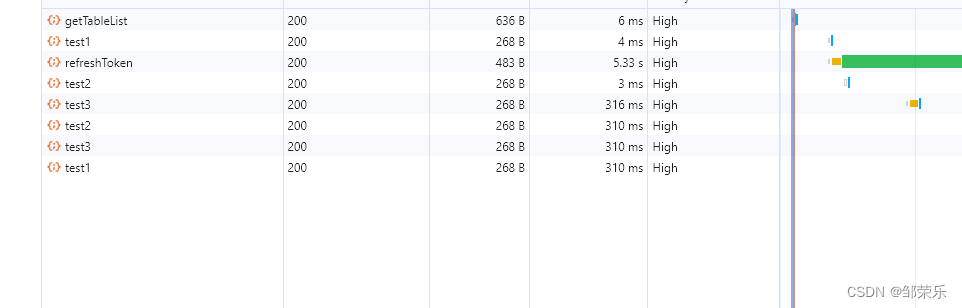

在vue前端开发中基于refreshToken和axios拦截器实现token的无感刷新

文章目录 一、需求背景二、token刷新的方案1、根据过期时间重新获取2、定时刷新token接口3、使用了RefreshToken 三、关于RefreshToken四、Refresh Token的优点五、Refresh Token的工作原理六、Refresh Token的使用流程七、Refresh Token的实现步骤1、登录成功后保存AccessToke…

HTML5:七天学会基础动画网页7

CSS3高级特效

2D转换方法

移动:translate()

旋转:rotate()

缩放:scale()

倾斜:skew()

属性:transform

作用:对元素进行移动,旋转,缩放,倾斜。

2D移动

设定元素从当前位置移动到给定位置(x,y)

方法 说明

translate(x,y) 2D转换 沿X轴和Y轴移…

30天JS挑战(第十五天)------本地存储菜谱

第十五天挑战(本地存储菜谱)

地址:https://javascript30.com/

所有内容均上传至gitee,答案不唯一,仅代表本人思路

中文详解:https://github.com/soyaine/JavaScript30

该详解是Soyaine及其团队整理编撰的,是对源代…

无人机镜头稳定的原理和相关算法

无人机的镜头稳定主要基于两个关键技术:镜头平衡技术和实时电子稳像。无人机镜头稳定的原理和相关算法主要是通过镜头平衡技术和实时电子稳像技术来保持摄像镜头的稳定性,从而拍摄出清晰、稳定的画面。无人机镜头稳定的原理主要是通过传感器和算法来实现…

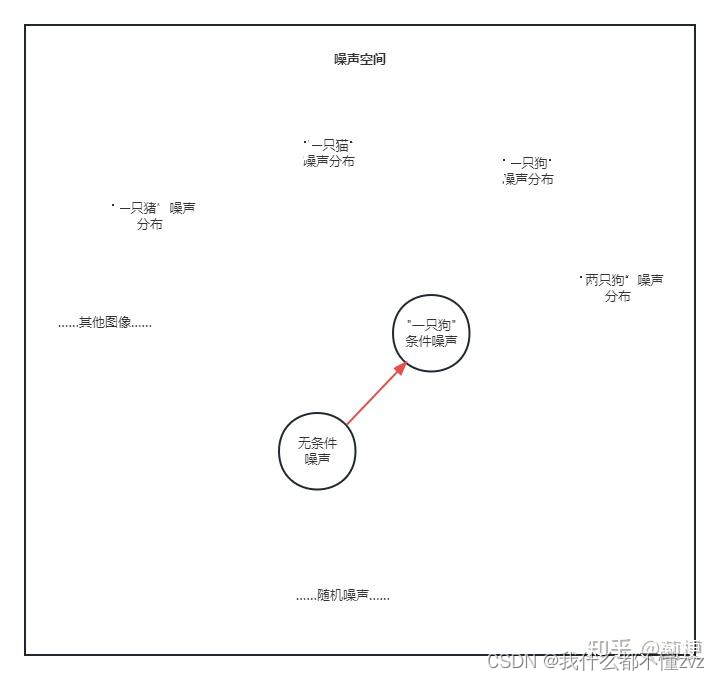

【扩散模型第三篇】Classifier Guidance 和 Classifier Free Guidance(CFG)及其代码

参考: [1] 张振虎博客 [2] https://www.bilibili.com/video/BV1s8411i7cU/?spm_id_from333.788&vd_source9e9b4b6471a6e98c3e756ce7f41eb134 [3] https://zhuanlan.zhihu.com/p/660518657 [4] https://zhuanlan.zhihu.com/p/640631667 进食顺序 1 前言2 Classi…

解释一下前端框架中的虚拟DOM(virtual DOM)和实际DOM(real DOM)之间的关系。

聚沙成塔每天进步一点点 ⭐ 专栏简介 前端入门之旅:探索Web开发的奇妙世界 欢迎来到前端入门之旅!感兴趣的可以订阅本专栏哦!这个专栏是为那些对Web开发感兴趣、刚刚踏入前端领域的朋友们量身打造的。无论你是完全的新手还是有一些基础的开发…

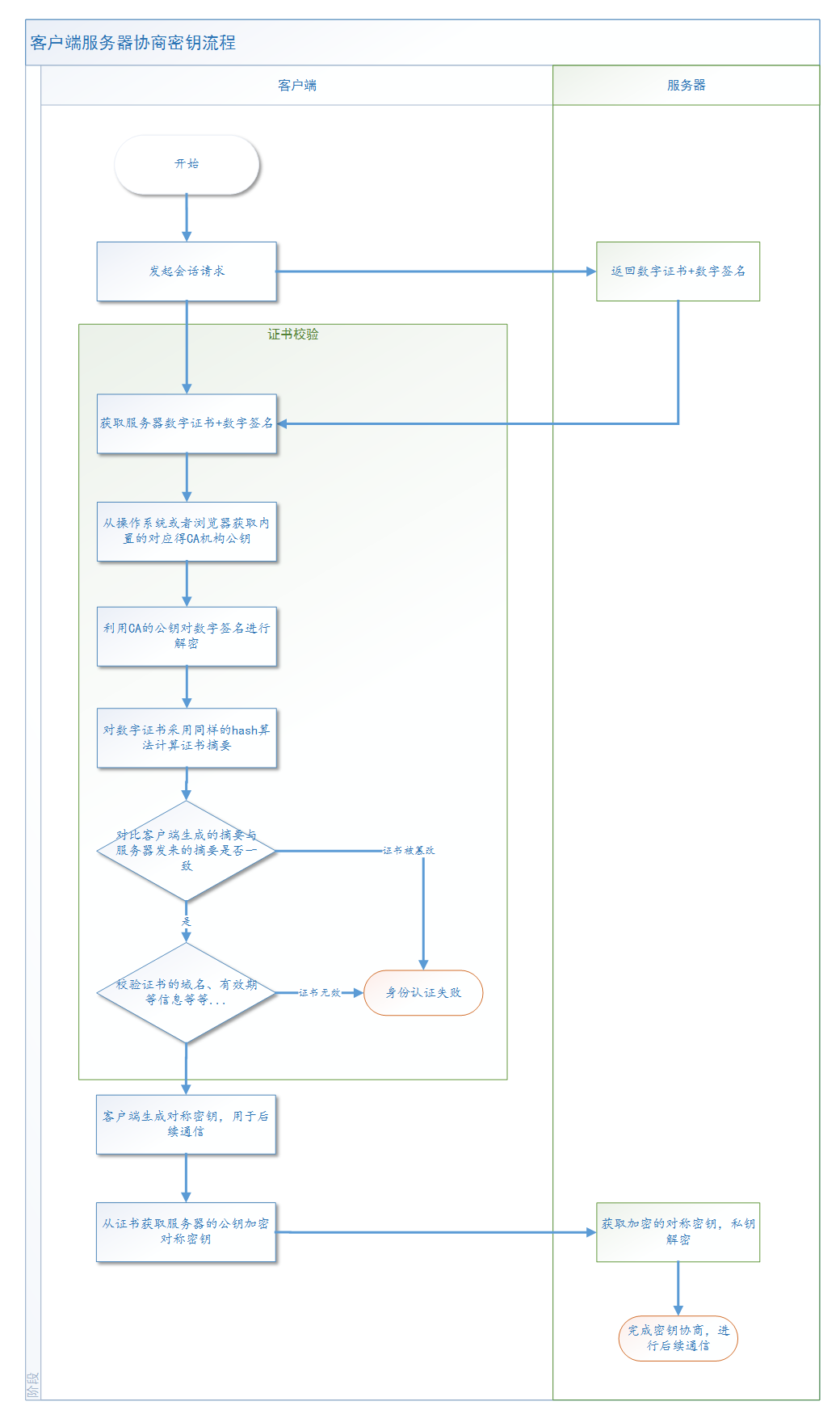

20240304-2-计算机网络

计算机网络

知识体系 Questions

1.计算机网络分层的优点和缺点

优点 各层之间是独立的;灵活性好;结构上可分割开;易于实现和维护;能促进标准化工作。 缺点: 降低效率;有些功能会在不同的层次中重复出现&…

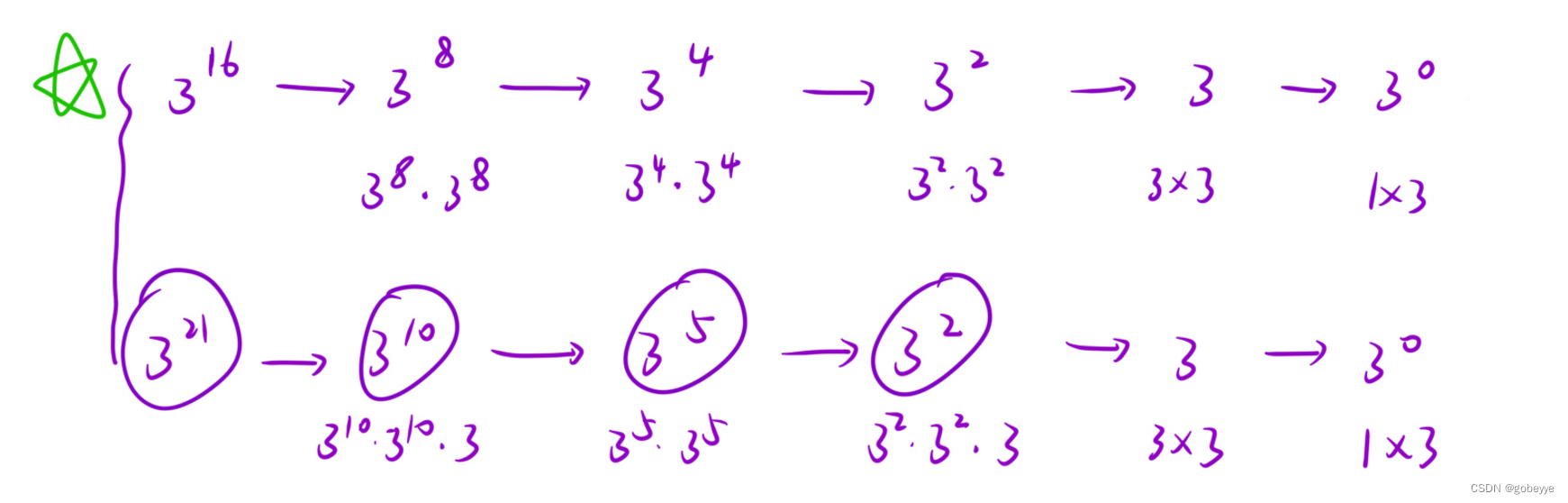

搜索回溯算法(DFS)1------递归

目录

简介:

递归问题解题的思路模板

例题1:汉诺塔

例题2:合并两个有序链表

例题3:反转链表

例题4:两两交换链表中的节点

例题5:Pow(x,n)-快速幂

结语: 简介&…

解决手机连接校园网同一设备老是需要重复认证的问题(+解决原理)

相信大家平时在使用校园网的时候总会遇到同一设备隔三岔五就要重复认证绑定的问题,这里直接附上解决方案。

打开手机的wifi-->连接校园网然后进入设置-->在隐私选项选择“使用设备MAC”

如下图,问题解决了!如果想知道原理的可以继续往…

速通C语言第十三站 预处理

系列文章目录 速通C语言系列 速通C语言第一站 一篇博客带你初识C语言 http://t.csdn.cn/N57xl 速通C语言第二站 一篇博客带你搞定分支循环 http://t.csdn.cn/Uwn7W 速通C语言第三站 一篇博客带你搞定函数 http://t.csdn.cn/bfrUM 速通C语言第四站 一篇博客带…

蓝桥杯备战刷题four(自用)

1.砝码称重 #include <iostream>

#include <vector>

using namespace std;

const int N110;

const int M100010;

int w[N];

int n;

int f[N][M];

int m;

int ans;

//f[i][j]表示到第i个砝码进行放置时的称得的重量为j的方案数

int main()

{cin>>n;for(int i1…

价格腰斩,腾讯云2024优惠活动云服务器62元一年,多配置报价

腾讯云服务器多少钱一年?62元一年起,2核2G3M配置,腾讯云2核4G5M轻量应用服务器218元一年、756元3年,4核16G12M服务器32元1个月、312元一年,8核32G22M服务器115元1个月、345元3个月,腾讯云服务器网txyfwq.co…